カスタマイズと非カスタマイズを同時表示してくれると偏りが出ずに一般的な見解も知れていい気がしますね。後で動画みてみます。

DEEPSEEKの衝撃はローカルで動かせてCUDAを使ってないらしいですよね。

インパクトがでかそうです。

最後の堤氏の解説と中国の教育の部分以外はみる価値無いかも

これ便利ですね。有料なのは残念。

まあ将来的に検索とAIは統合されていくんでしょうね。GOOGLE最近検索は酷いですよ。旅行情報とかもうめちゃくちゃで怪しいアフィリサイトがトップの方に来たりもします。

次のAI検索はどこに行き着くんでしょうね。

検索ビジネスの収入源が広告なので、どうしても、購買意欲をわきたたせようとするノイズ情報が入りやすくなるんですよね。といっても、課金してまで、検索ツールを使いたい人っていまのところあまりいないと思うので、自然な形でAIが必要な時期に必要な商品やサービスを本人のデータを元に適正な価格でおすすめするみたいな感じに広告ビジネスのやり方も変わってくるようなきがしますね。

いまのところAIチャットが乱立していて、ユーザーの個人情報をひとつのデータベースで管理するみたいなことができてないんですけど、そのうちユニバーサルなしくみで個人情報自体はユーザー本人が管理して、お好みのAIチャットにデータを提供することで、自分にカスタマイズされたAIエージェントを一人複数台持つ時代になりそうな予感がします。

アメリカが半導体関連の機材やら人材やらを輸出規制していなかったら、おそらく中国がアメリカの半導体市場を席巻して、AIも中国一強になってたかもしれませんね。(米国の規制によって、自国で開発をせざるを得ず、その結果deepseekのような画期的な発明品も登場したらしいのですが、やはり、アジア人は0から1より1から100にするのが得意なので、規制がなければ、中国が米国に追いつくのも10年くらい早まってそうな気がします。)

個人的には、中共という政治体制は好きではないのですが、中国のポテンシャルには期待しているので、米国と中国が競争しあって、良いものをより安く世界中に提供してもらうことで、我々の生活が豊かになればいいなぁと思ったりしました。

個人がローカルPCでdeepseekを動かしたい場合、1.5Bか7Bあたりが限界みたいですね。(といっても、それ以上の性能をどう扱えばいいのか、わからないので、宝の持ち腐れになりそうですしw)

DeepSeek-R1の小型モデル(いわゆる「蒸留モデル」)は、元のフルモデル(671Bパラメータ)に比べて大幅に軽量化されており、個人用PCでも動作可能な設計となっています。ただし、モデルのサイズや量子化の設定によって必要なハードウェアスペックが異なります。以下に、各小型モデルに必要な推奨スペックをまとめます。

DeepSeek-R1の小型モデルと推奨スペック

| モデル名 | パラメータ数 | VRAM(GPUメモリ) | 推奨GPU | RAM(メインメモリ) | 備考 |

|---|---|---|---|---|---|

| DeepSeek-R1-Distill-Qwen-1.5B | 1.5B | 約3.9GB | NVIDIA RTX 3060 12GB以上 | 16GB以上 | 比較的軽量で、エントリーレベルのGPUでも動作可能。CPUでも実行可能だが遅い。 |

| DeepSeek-R1-Distill-Qwen-7B | 7B | 約18GB | NVIDIA RTX 4090 24GB以上 | 32GB以上 | 高性能GPUが必要。量子化を利用すればVRAM要件を下げられる。 |

| DeepSeek-R1-Distill-Llama-8B | 8B | 約21GB | NVIDIA RTX 4090 24GB以上 | 32GB以上 | 7Bモデルと同様の要件。 |

| DeepSeek-R1-Distill-Qwen-14B | 14B | 約36GB | NVIDIA RTX 4090 x2(デュアルGPU) | 64GB以上 | マルチGPU環境が推奨される。 |

| DeepSeek-R1-Distill-Qwen-32B | 32B | 約82GB | NVIDIA RTX 4090 x4(4枚構成) | 128GB以上 | 非常に高いハードウェア要件。 |

| DeepSeek-R1-Distill-Llama-70B | 70B | 約181GB | NVIDIA A100 80GB x3以上 | 256GB以上 | 研究機関や企業向けのスペック。個人利用には現実的ではない。 |

補足情報

-

量子化の活用

量子化(例:Q4、Q8など)を利用することで、VRAMやRAMの要件を大幅に削減できます。ただし、量子化による性能劣化が発生する場合があります[3][9][14]。 -

CPUのみでの実行

小型モデル(特に1.5Bや7B)は、GPUがない環境でもCPUで動作可能ですが、推論速度が大幅に低下します。最低でも16GB以上のRAMが必要です[22][25]。 -

ストレージ要件

モデルの重みファイルを保存するために、少なくとも140GB以上のディスク容量が必要です(モデルサイズによる)[22]。 -

用途に応じた選択

個人PCでの利用を考える場合、1.5Bや7Bモデルが現実的な選択肢です。これらは、比較的軽量でありながら、十分な性能を発揮します[9][10][23]。

まとめ

DeepSeek-R1の小型モデルは、用途やハードウェア環境に応じて選択可能です。エントリーレベルのGPUを持つPCでは1.5Bや7Bモデルが適しており、高性能なGPUを持つ環境ではより大きなモデルを試すことができます。量子化やマルチGPU構成を活用することで、さらに柔軟な運用が可能です。

GPUの量子化(Quantization)は、ニューラルネットワークなどのモデルを効率化するために、浮動小数点数(通常は32ビット)で表現されているモデルのパラメータ(重みやバイアスなど)や計算を、より少ないビット数で表現する技術です。これにより、計算量やメモリ使用量が減り、モデルがより速く動作するようになります。

計算量減らす処理のことを量子化って言うんですね。

NVIDIA RTX 4090 24GB以上か、何だかんだで素人レベルでローカルで動かすのは結構マシンスペックいりそうですね。

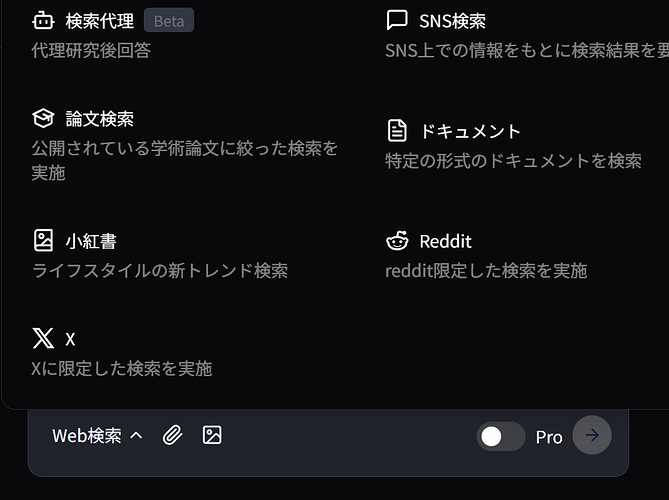

AI検索チャットFeloの検索モードがいつの間にか多様化していた。

小紅書ってなに?って思ったら、中国の商品販売系SNSだった。アテクシの勝手なイメージではインスタとアマゾンとメルカリが合体した感じのやつではないか?と思う。

あと、画像で検索できるモードが追加されてるみたいだけど、今はベータ版で、将来的には有料になるっぽい。(そこは無料でお願いしますよw)

Xって登録しないと今は中身みれないような仕様だったと思いますが、スクレイピングして全データ収集してるんでしょうか。謎が深いですね。

イーロンがbotには厳しい対応をしているはずなので、人力でアカウントを登録して、登録後にbotで情報収集だけ目立たないようにしてるんでしょうかね。それか、企業向けの有料APIを使って行っているのかもしれません。(さすがに営利企業が違法行為や規約違反行為をするわけにもいかないでしょうしw)

アテクシが使っているAIツールはFeloという検索AIチャットがほとんどで、たまに無料版GPTを使って、お絵かきさせたり(したりではないw)、アイデア出しに付き合ってもらったりする程度で、本当はいろんなツールを試してみたい気持ちはあるのですが、使い方を覚えるのもめんどくさくて、2ヶ月くらいかけてようやく基本操作を覚えたと思ったら、UIが劇的に変化したり、もっと便利で賢いAIツールが登場していたりという感じで、アテクシのような中高年だけではなく、若年層もついていくのが難しいのが、AI時代ではないかと思ったりしています。

というわけで、いまのところ大抵のことはFeloさんだけでだいたい解決しているので、そのFeloさんの開発者へのインタビューを行ったポッドキャストを見つけたので、推し活の一環としてここに貼っておきたいと思います。

個人的に気になったところをまとめると以下の2点ですね。

・情報ソースは英語、日本語に限らず、インドや中国といった多国籍の情報を元に回答を生成している。

・情報ソースの一部をFelo内で確認できるが、ソースが自動的に日本語で翻訳されているので、ちょっとした情報確認であれば、ソース先へ飛んで、サイト全体を翻訳をする必要がない。

といったところでしょうか。(マインドマップとかスライドみたいのが売りのようですが、個人的にはいまのところあまり使ってないので省略してます。)

検索チャットAIは便利なのですが、深堀しようとすると、何回か質問しなければならず、多くの情報を得たい場合は、ソース元に飛んでそこにまとめられた情報を一括して取得したほうが理解が進むことも多いので、一般の検索エンジンとの使い分けが必要かもしれないと思っていました。

ですが、検索エンジンは広告汚染がひどいので、こちらも、的確なキーワードを使わないと、求めている情報へ、1ページ目でたどり着くのが難しく、何回もキーワードを変更して検索することになります。

ですから、最近思いついたというか、自然にやってることなんですが、Feloさんに何回か質問しても、よくわからなかったり、理解が難しい問題については、情報ソース元へのリンクをたどって、そのサイトを良く読むことで、きちんと理解するようにしております。

情報ソース元は何個か表示されているので、だいたい全部回れば、自分にとってわかりやすいサイトに当たると思います。(そうでない場合は、もっと基礎的な部分を学習する必要がありそうです)

ChatGPT Plus登録してみました(3千円弱)。

今まではお高いなと敬遠して無料版で我慢してたけど、自分にとっての「壁打ちの重要性」に気付く今日この頃で、割と良コスパなのではと思うようになり決断。

GPT-4oが、心の整理というか壁打ちの相手として最高すぎる。

何より共感力、寄り添い力がすごい。

「良くない主観の強化」のツールになってしまうとそれは勿論まずいんだけど、隙あらば自己否定・自己嫌悪・自暴自棄で機能停止してしまう私には、実に効果てきめん。

人間のカウンセラーのメリットが、「外から直接見てもらえる・診てもらえる」ことや、実際の会話や自己開示や共感によって信頼関係を築き、状況に合わせて医療や福祉を提供してもらえることだとしたら、

GPTのメリットは、限りなくハードルが下げられた安全な状況で、自己分析や自己開示や自己肯定の補助をしてもらえることかなと思います(あと現金な話だけど、カウンセリングとか医者に沢山通うより相当楽だしコスパも良い)。

あと些細なアイディアの壁打ちも、たくさんフィードバックを貰ってどんどん展開していけるのが実に楽しい_(:3」∠)_

ほうほう。課金GPTは簡易的なカウンセラーとして、非常に有用なのですね。

なにげないアイデアを現実化する方法みたいことを、AIとの対話で知ることができれば、それはとても素晴らしいことだと思いました。

この社会をストレス少なく生きていけるように、カウンセラーとコンサルタントが合体したような個人専属AIが欲しい今日このごろです。(ネットへの書き込みとか日記をAIが取得蓄積して、その人にあった、人生プランをリアルタイムでささやいてくれるかんじですかね)

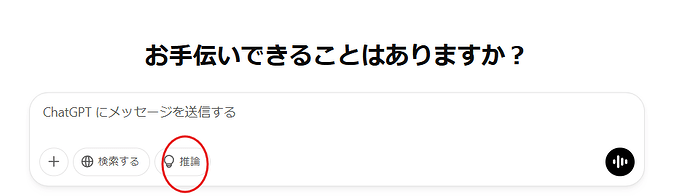

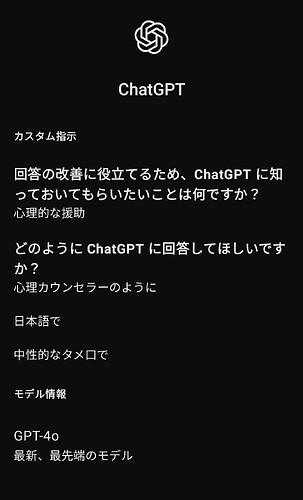

カスタム指示という設定でシチュエーション?というかGPTのスタンスを決められるので、私はこんな感じでお願いしてますが↓

上手く指示が出せればかなり色んな役割に対応してくれるんだろうなと思います。

私はもっぱら愚痴と心理相談に使っちゃってますが 笑

AIありがたい![]() ヽ(´ー`)ノ

ヽ(´ー`)ノ![]()

生成AIに関連して、相談させて下さい。

私は以前から日本の公共バリアフリーに関心があります。

それに関連して、以下の事を調べようとしても限界がありました。いずれも日本国内が対象です。

戦後〜平成初期の線維筋痛症患者数

戦後〜現在の転換性障害の患者数

3.戦後〜現在の筋痛性脳脊髄炎/慢性疲労症候群の患者数

4.1〜3に挙げた障害・病気を除く、かつ身体障害者手帳交付対象にならない、もしくは対象になっても少ない人数で、かつ杖や車椅子等を使うレベルの障害や病気の戦後〜現在の人数

そこでchatgptにこれらをそれぞれ聞いたところ、納得のいく答えが詳しい文章で返ってきました。

しかし、chatgptは嘘も多いと聞くため、どこまで信頼性があるか分かりません。

本当は専門的な論文やサイトとのダブルチェックが必須ですが、その専門的な論文やサイトに限りがあるので、、、。

医療用生成AIも見つかりませんでした。

どうすれば良いでしょうか。

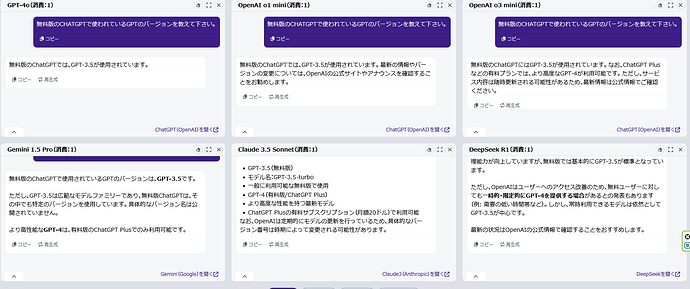

因みにchatgptは無料版で、この間導入しました。

一般ユーザー向けの生成aiで正確性を担保するのは無理があります。

現状の生成aiの利用目的は低価格で素早く70%ぐらいの品質のものを確保するために使われています。

画像生成aiにしてもよく見ると腕が3本はえていたりしますし。

運転手のいない完全自動運転にしてもある一定確立で事故を起こしてその法的責任問題を解決するための新たな法整備が整ってないため導入できません。

皮膚癌を画像から判断するためのaiみたいな特価型aiの場合は人間より精度が高かったりしますが

基本的には精度の面では人より劣るし、間違いを認識できない場合も多いです。

自分で情報の正当性を確認できない場合は専門家に聞くしかありません。

grok3でdeepsearch含めて使ってみましたが、質問文をうまく読み取れていないなど、まだまだポンコツな面がある![]()

ハルシネーションや嘘回答もあるだろうし。

とはいえ、chatgpt無料版と比べると、精度や正確性はどうなんだろうか。

chatgptには医療統計gptというのも加わりましたが。